自動駕駛的倫理困境:假如事故不可避免,救乘客還是路人?

原標題:自動駕駛的倫理困境:假如事故不可避免,救乘客還是路人?

一旦自動駕駛汽車上路,必然面臨這種倫理難題,也就是讓汽車在事故之前選擇殺一人還是殺幾人的問題,並且,人工智慧的設計可能會陷入無盡的矛盾中。

冰川思想庫特約研究員 | 張田勘

人工智慧已經演變為爭奪未來的戰略高地,得人工智慧者得天下!自動(無人)駕駛汽車是人工智慧的代表之一,比起最新的阿爾法元(Alpha Go Zero)無師自通得道成精,戰勝阿爾法狗(Alpha Go)來,自動駕駛的實用性更強,經濟增量更大,也更吸引人。

2017年10月17日,百度Apollo(阿波羅)與廈門金龍聯合汽車工業有限公司(金龍客車)簽署戰略合作協議,雙方將於2018年7月小批量產合作研發的無人駕駛微循環車,將在後續投入試運營。這將是國內首個實現量產的無人駕駛客車。

▲百度與金龍客車聯合打造的無人駕駛微循環車

然而,無人駕駛汽車上路,需要獲得技術、倫理、法律和管理多重通關,只有取得各處關文書,無人駕駛汽車才能上路。其中,自動駕駛的關口最重要的可能不在技術,而在於人文倫理和社會法律。

自動駕駛安全嗎?

講真,百度的無人駕駛汽車能否在2018年上路其實很懸。他們要生產的只是無人駕駛微循環車,定位於解決「最後一公里」的出行問題,是在特定環境運營,如大型園區內的接駁車、機場擺渡車、旅遊景點的觀光車等。這類場地駕駛環境簡單、路線單一,便於發揮無人駕駛的優勢。但是,在複雜的路面,首先需要解決安全問題。

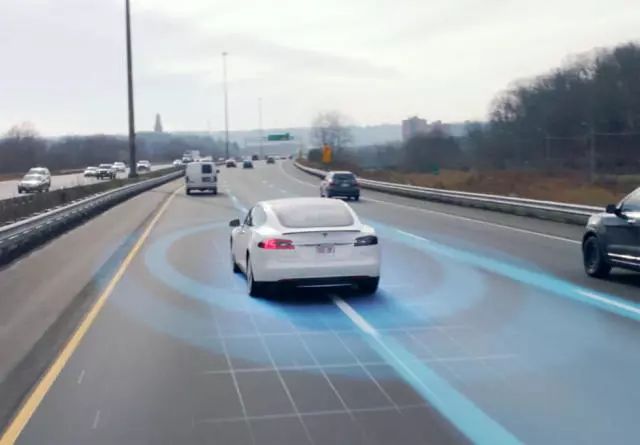

我們可以拿智能汽車的急先鋒特斯拉的Autopilot來說事。Autopilot是一個自動駕駛軟體,它配備於特斯拉的一款稱為Model S的汽車上。

2016年5月7日,美國俄亥俄州坎頓市的前海軍海豹突擊隊員約書亞·布朗(Joshua Brown)駕駛Model S在佛羅里達州威利斯頓附近的雙向高速公路上行駛時,與一輛拖挂車相撞,不幸身亡。這是全球第一起因自動駕駛而致死的事故。

▲約書亞·布朗曾在視頻中展示雙手離開方向盤

事後,美國國家高速公路交通安全管理局(NHTSA)針對Autopilot功能展開調查。經過半年的調查,NHTSA於2017年1月19日宣布,未發現Autopilot功能存在問題,同時不會要求特斯拉對汽車進行召回。NHTSA的結論是,特斯拉Autopilot不是完全自動駕駛系統,它根本無法應對所有路況,司機不應該依靠它來防止此類事故。

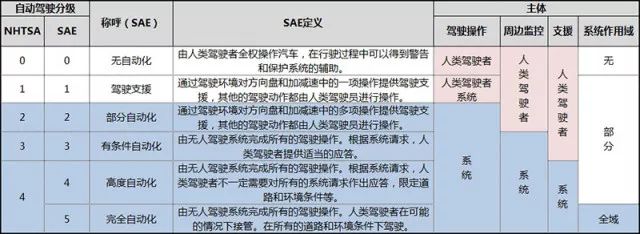

Autopilot裝備的Model S屬於自動駕駛的L2級,離完全自動的L5級差得太遠,並且布朗本人有太多疏忽。事發前37分鐘的行程中,約書亞?布朗的手僅有25秒被檢測到手握方向盤。Autopilot自動輔助駕駛系統向布朗發出了7次視覺警告,該系統還發出了持續一到三秒的警告鈴聲,並6次發出「手需要放在方向盤上,但系統未檢測到」的語音警告,但布朗無動於衷。

而且,車禍發生之前,布朗是超速行駛。在車禍發生前2分鐘,布朗採取的最後一個動作是將車速設定為74英里每小時(時速約119公里),高於每小時65英里的限速。而且,最令人唏噓的是,在車禍發生時布朗正在車上觀看哈利·波特電影(DVD)。

除了人禍之外,自動駕駛技術並非沒有缺陷。儘管Autopilot開啟了功能並提醒布朗注意,但強烈的日照和拖挂車白色車身讓Model S的Autopilot系統攝像頭短暫「失明」,未能夠在白天強光下及時發現拖車白色側面的反光,導致在自動駕駛模式下的剎車功能未能緊急啟動,使得Model S擋風玻璃與挂車底部直接發生撞擊。

Autopilot的攝像頭有問題說明自動駕駛在技術上還處於初級階段,特斯拉公司也向美國高速公路交通安全管理局下屬的缺陷調查辦公室提供了配置Autopilot技術的Model S和Model X等汽車在2014年至2016年期間所有行駛里程和安全氣囊相關的數據。

不過,調查人員利用這些數據計算了Autopilot系統安裝前後的撞車率,得出特斯拉安裝了Autopilot系統後汽車更安全的結論。美國高速公路交通安全管理局也承認,自從特斯拉汽車於2015年安裝了Autosteer(方向盤自主轉向)軟體以來,特斯拉汽車的撞車率已經下降了40%左右。Autosteer是Autopilot系統的功能之一,能夠讓特斯拉汽車保持在自己的車道上行駛,即使遇到彎道仍能夠讓汽車自行轉彎。

▲自動駕駛等級劃分依據

如果特斯拉改進,會在未來解決技術上的一系列問題,讓無人駕駛汽車更為安全。美國2016年的統計表明,美國公路上因交通事故喪生的人數超過3.5萬人,其中94%的事故是因司機失誤導致的。但是,美國特斯拉的車主使用自動駕駛儀(只是L2級)的行駛距離超過1.3億英里,才只出過一次致死事故。毫無疑問,無人駕駛汽車的安全性高於人類的老司機。

現在,特斯拉的自動汽車才達到L2,要達到自動汽車的最高級L5(全自動)還有很長的路要走,因此,在時間上並非三五年就可以讓完全自動的L5級無人駕駛車上路。

自動駕駛面臨的倫理難題

即便所有的技術都能解決,無論從理論還是實踐看,自動駕駛不會100%的安全,總會出錯,因此,出錯前如何躲避?目前,人都解不了這個方程,自動汽車能解答嗎?

如果人駕駛汽車,一個普遍的現象是,在出車禍的一瞬間駕駛員是往左打方向盤,以避免自己被撞上,這是下意識的舉動。但也有調查發現,駕駛員在右前方有障礙(人和物)時是往左打方向盤,反之則往右打方向盤,這也是一種本能。但是,更多的可能是,人駕駛汽車在出車禍的一剎那來不及做出什麼反應,因為車速太快和事故發生太突然,無法做出規避動作。

自動駕駛汽車要面臨一種選擇,即電車難題——最早由英國哲學家菲利帕·福特(Philippa Foot)在1967年發表的《墮胎問題和教條雙重影響》中提出。但是,更早則起源於伯納德·威廉姆斯提出的槍決原住民問題。一名獨裁者以涉嫌叛亂為由要處決20名無辜的印第安人,此時有一名外來旅遊的科學家在場,獨裁者稱如果由科學家親手槍決1名印第安人,就可以赦免19人,那麼這名科學家該不該這麼做?

福特由此進一步提出,如果5名無辜的人被綁在電車軌道上,一輛失控的電車朝他們駛來,片刻後就要碾壓到他們。幸運的是,你可以拉一個拉杆,讓電車開到另一條軌道上。但是在那另一條軌道上也綁了一個人。因此,你有兩個選擇:不拉杆,5人死亡;拉杆,一人死亡。你會怎麼做?

這樣的選擇可以歸結為利益的最大化或損失的最小化,即功利主義。按利益最大化和後果最小化,多數人都會選擇拉杆,讓1人死亡救5人。但是,這也意味著,拉杆讓1人死亡還是殺了人,對此也要負良心的責任。所以無論是讓1人死亡還是5人死亡,都躲不過良心的譴責。

一旦自動駕駛汽車上路,必然面臨這種倫理難題,也就是讓汽車在事故之前選擇殺一人還是殺幾人的問題,並且,人工智慧的設計可能會陷入無盡的矛盾中。例如,如果是以死人的多少來設計人工智慧的操作程序,那麼接下來是否還會根據年齡、性別、地位的高低來選擇事故中的拉杆。例如,面對一位孕婦和一位老人,汽車出事前該撞向誰。如果這樣的話,是否也把人變成三六九等,並違背生命面前人人平等的原則。

無人駕駛就是迫使人工智慧把人分等級,按人的多與少、高貴與貧賤、窮與富來選擇,所以躲不開功利主義。當然,這種功利主義還是人的選擇,因為智能軟體是人設計的,不過,人工智慧的選擇也許要優於人的選擇。因為,在面臨5人與1人時,如果人類駕駛員看到的那1人是自己的親朋,或許會選擇衝撞陌生的5人,但無人駕駛汽車只會按設計的救多數犧牲少數的程序來行事,所以似乎顯得更公平。

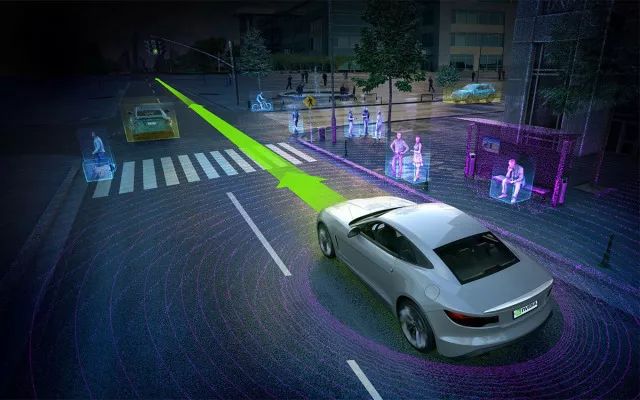

現在,新的研究還在擴大和證明無人駕駛面臨更複雜的倫理選擇,例如在將要發生事故時,是拯救車上的乘客還是挽救路人。法國圖盧茲大學經濟學院和美國俄勒岡大學、麻省理工學院的研究人員合作,並在2016年6月24日的《科學》雜誌上發表了幾項研究結果。其一,假如存在一場不可避免的事故,是救乘客還是路人?

研究人員在線諮詢了451人,當車上只有一名乘客並且只有一名行人時,75%的受試者表示應該救乘客。但是當行人的數量增加時,受試者開始轉變立場。如果有5名行人和1名乘客,50%的受試者表示應該救乘客。當行人人數達到100人,乘客是1人時,有80%左右的受試者表示要救行人。

其二,研究人員詢問了259人,自動駕駛汽車是否應該給車輛設定程序以保護「人數更多的一方」?結果以100點評級方式來衡量,受試者對這一問題的平均支持點數為70點。但是當被問及他們是否願意購買犧牲駕駛員的車輛時,其興趣大幅下降,支持點數僅為30點。

上述研究結果反映了人們對於自動駕駛汽車的矛盾心態。人們並非接受保護多數人的觀點,而是趨向於保護車中的乘客,哪怕車上的乘客明顯少於行人。同時,人們又支持為車輛設定程序以保護人多的一方,並且對自動駕駛汽車不太感興趣(不太願意購買犧牲駕駛員的車輛)。

所以,對自動駕駛汽車是人為設定程序還是讓其自主決策,以及電車難題是否會造成自動駕駛汽車的困境,莫衷一是。不過,在討論自動駕駛的倫理難題時,有人提出了兩個關鍵點。一是不能把人的生命交由人工智慧來處置,即自動駕駛的系統編程不應在人的生命中進行挑選,也不應該在受害者中進行抵消,但自動駕駛應秉持損害最小化原則。

▲百度無人駕駛汽車

二是,自動駕駛應避免陷入電車兩難。從車輛的設計和編程開始,就應考慮以一種具備防禦性和可預期的方式駕駛,自動駕駛應重在完善技術,並通過可控交通環境的應用、車輛感測器、剎車性能、危險情況中給受威脅者發出信號提示、通過「智能」道路基礎設施等來預防危險,最大程度地增強道路安全性,避免兩難局面的發生。

然而,要實現這兩點除了不太可能外,還陷入自相矛盾之中,例如,不應在自動駕駛的編程中涉及功利主義的程序,但又要求自動駕駛應秉持損害最小化原則,後者本身就是功利主義選擇。

法律對自動汽車開了一個口子

人無論做什麼事情,都要對結果負責,所以有自然人和法人的負責形式。但是,自動駕駛沒有人,其運營和出了事後誰負責呢?所以,在沒解決這個問題之前,1968年聯合國制定的道路交通公約規定,汽車的控制者必須是人而非電腦。

不過,法律是人制定的,也是隨時代發展而變化的,為適應自動汽車上路,美國和其他一些國家已經解凍自動駕駛汽車的法律,允許自動駕駛汽車有條件地上路。自動駕駛汽車上路最大的法律基礎或法理是,把研發、生產自動駕駛汽車的人員和機構作為責任人(法人)。儘管如此,現今的法律也只是有條件地允許自動駕汽車上路,主要是測試。

2017年10月12日美國加利福尼亞州車輛管理局宣布,從2018年6月起允許沒有方向盤、制動踏板、後視鏡和沒有駕駛員的無人駕駛汽車在道路上進行測試,允許公眾乘坐配有無人駕駛技術的車輛。所有上路測試的自動汽車都屬於L3級自動駕駛汽車,在某些情況下依然還需要人工干預。

此外,美國國會正考慮立法,允許廠商生產和部署沒有踏板和方向盤的非傳統類型汽車,同時還允許各州政府制定單獨的自動駕駛監管法案。

▲谷歌的無人駕駛汽車一開始是沒有方向盤的

相比而言,德國的法律更進了一步。2017年5月12日,德國聯邦參議院通過首部自動駕駛汽車的法律,允許汽車自動駕駛系統未來在特定條件下代替人類駕駛。這部法律首先明確了法律責任,如果在人為駕駛的情況下發生事故,駕駛人承擔事故責任;如果是人工智慧系統引發事故,將由汽車製造商承擔責任。

判斷人為駕駛還是自動駕駛將由汽車上安裝的一個類似黑匣子的裝置來確認,該裝置可以記錄系統運作、要求介入和人工駕駛等不同階段的具體駕駛情況,以保證在出現交通安全事故時,明確責任劃分。

當然,德國的這部法律也還不涉及自動駕駛的最高級L5級,該法律規定駕駛席必須有司機,並且要保留方向盤、油門和剎車等配置,以保證在自動駕駛系統出現故障的情況下,駕駛者能及時介入,進行人工駕駛,並且在何時能讓自動汽車上路也語焉不詳。

2017年10月14日,日本國土交通省首次推出了關於自動駕駛的安全標準。規定必須搭載一種功能,在路上自動行駛時,當司機手離開方向盤超過65秒就自動切換為手動駕駛模式,當駕駛者的手離開方向盤駕駛15秒以上,自動系統將向駕駛席發出警告。如繼續保持手離開方向盤的狀態,50秒後自動駕駛系統將停止,切換為手動駕駛。

該規定只適用於2019年10月起具備自動駕駛功能的新車型。目前正在銷售的車型從2021年4月起適用該標準,二手車除外。

顯然,德國的自動駕駛汽車的法律最開放,但時間未定,美國次之,日本的基本還算不上自動駕駛法規。不過,中國尚無自動駕駛汽車的法律。因此,無論是國外還是國內,自動駕駛汽車上路和運營還有漫長的路要走。

※懂得了什麼是體面,中年男人才會遠離油膩

※大多數的知識付費,其實就是賣給你一套標準答案

※在阿根廷探尋切·格瓦拉的生活軌跡

TAG:冰川思想庫 |