瑞立視正式對外發布VR多人同時全身動捕軟體,開啟深度人機交互時代

原標題:瑞立視正式對外發布VR多人同時全身動捕軟體,開啟深度人機交互時代

聲明:本文系新聞稿(第三方稿件),非映維網官方稿件,望讀者知悉。本文內容涉及任何法律問題均與映維網無關。禁止以「來源映維網(YiVian)」名義轉載本文。

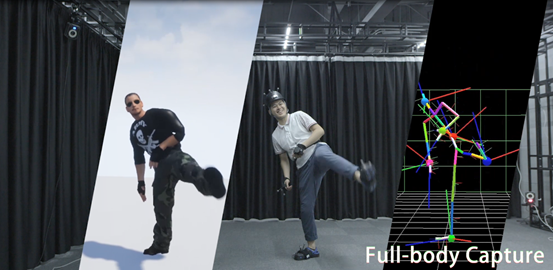

RTS-Tenoomi 全身動捕

作為下一代計算平台,虛擬現實(VR)產業不但有提供平台和資源的巨頭爭相加入VR市場陣營,而且深耕行業應用的優質企業也漸露崢嶸,多人同場景內互動已經逐漸成為VR解決方案的一種標配,越來越多針對各自垂直行業的VR成功案例便是VR行業良好發展態勢的有力佐證。然而,目前國內大多數多人互動大空間VR方案往往只能追蹤到玩家雙手和頭部的信息,在互相共處的虛擬空間里,玩家之間只能看到對方準確的頭和手的位置,卻沒有完整的身體姿態同步。在某些行業應用的需求里,這大大降低了VR的沉浸感和互動真實度,限制了用戶體驗,也限制了行業發展。據悉,為順應VR行業應用發展趨勢,解決捕捉局限,全面升級核心技術,革新VR行業發展,引領虛擬現實「行業應用」進入更深度更逼真的人機交互時代,國內領先動作捕捉企業深圳市瑞立視多媒體科技有限公司,已正式宣布,即將推出用於多人全身動作捕捉的軟體Tenoomi和Rovonga兩位「新成員」:

RTS-Tenoomi 全身動捕展示圖

即將迎來的全身動捕「新成員」——

RTS-Tenoomi是瑞立視(Realis)推出的一款基於剛體的全身運動捕捉軟體,適用於VR虛擬現實,虛擬主播,虛擬拍攝等需要實時(Real-time)進行人機交互的場合。於2018年5月已正式發布並可投入商用。軟體最大的特色是除了全身動作捕捉等基本功能之外,其SDK將直接與各大VR引擎(虛幻4,Unity等)進行無縫對接。體驗者的身體動作會直接表現在VR引擎內,與場景內的模型和交互邏輯進行零時延的精準互動。

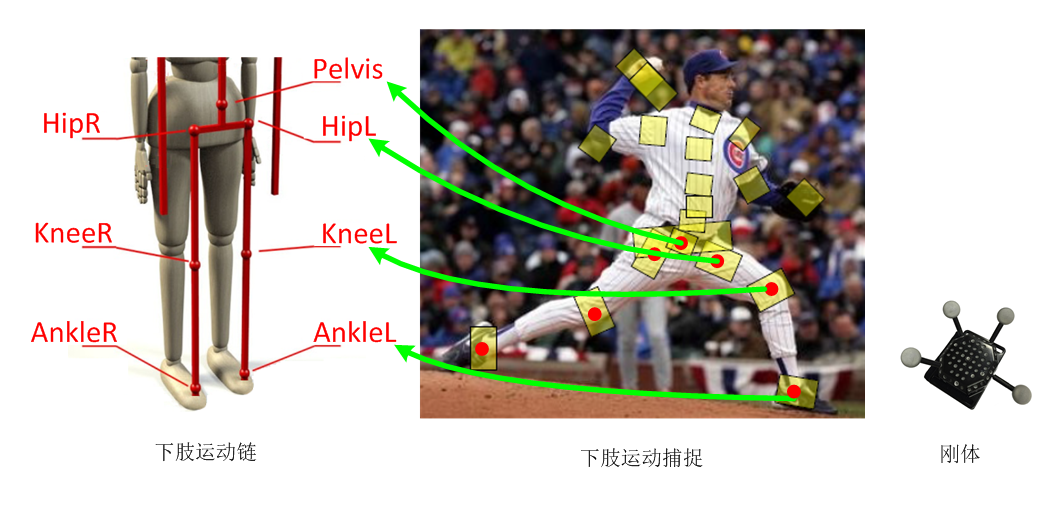

Tenoomi工作時,要求在表演者的頭部、雙手、雙腳以及背部布置剛體,接收瑞立視(Realis)的跟蹤定位軟體RTS-Tracker傳來的表演者身上的剛體數據(剛體的位置及朝向信息),獲取表演者的肢端位置,然後結合IK技術以及HSM模型進行全身骨骼解算,估算出表演者的全身動作骨骼姿態。

據悉, Tenoomi具有以下特點:

高效自然的數據解算

RTS-Tenoomi可一鍵獲取來自RTS-Tracker的高精度剛體數據,每個人只需6個剛體數據,便可進行全身骨骼解算,數據處理量少,從而能實現低延時的多人精準的實時交互。要知道,傳統的動作捕捉常見的一種手法是表演者需換上貼身的緊身衣,在緊身衣上貼滿數十個反光點,或是穿上渾身節點和線纜的慣性式穿戴設備。其目的是做到高流暢度的動作結算。然而,考慮到VR應用必須滿足的高效型和穿戴性,VR的體驗者們不可能每次體驗前都進行繁瑣的穿戴或緊身衣服的更換。因此,Tenoomi在設計了進行骨骼解算與重定向時,對用戶體型和重定向的人物模型無要求,即只需6個剛體數據,無論用戶胖瘦、高矮皆可解算出自然流暢的全身骨骼姿態,並將骨骼重定向到不同比例、不同骨骼的虛擬人物模型上,具有很強的實用性。

支持在線多人實時交互

目前國外可見的全身動捕軟體中,雖然能實現全身流暢的動捕,但大部分以支持在線錄製影視,體育科研等動作和線下動作編輯為主,較少有在線多人全身動捕的實時交互應用。因為現有的全身動捕過程中,交互的數據處理量龐大,一旦進行多人同時實時捕捉,容易在VR里產生嚴重的延遲,這是體驗者無法接受的。多人在線實時全身互動過程中,有如下問題:單人的全身動捕很容易做到,但是同一個場景多人的全身動捕就很困難,因為每多一個人,全身動捕的剛體數量就直線上升,如何進行數據處理,如何規避和估算遮擋,如何進行骨骼解算才能保證實時性和高精準度同時交互;

為解決上述問題,瑞立視推出的RTS-Tenoomi在數據處理方面做了大量的優化,首先是體驗者的穿戴剛體數減少到了6個,這減少了源數據量。但為保證全身骨骼估算效果,Tenoomi應用了具有瑞立視自主知識產權的骨骼姿態演算法進行骨骼解算,該演算法能夠成功優化遮擋問題,並且在源數據量較少的情況下也能進行精確、流暢、自然的全身骨骼估算,從而能夠保證多人同時在線實時的全身互動,這在業界內非常少見的。

良好的用戶體驗

Tenoomi具有友好的UI交互介面,能夠給用戶良好的交互體驗。用戶在體驗時,無需穿上特製的衣服,只需戴上簡單手套或腳套,穿戴方便,便於體驗。並且,在體驗者體型相差不大的情況下,即使用戶發生變化,Tenoomi在不更換解算器的情況下也能精確進行全身解算,這樣可以簡化用戶操作流程,提升用戶體驗。

Unreal Engine、Unity引擎無縫對接

Tenoomi同時捆綁其專用的UE4/Unity SDK進行發布。不管開發者用的是哪個引擎,哪個版本,Tenoomi都能進行無縫對接與支持。想要在VR里實現全身動作捕捉的開發者們不用再去編輯自己的IK藍圖或C++代碼,Tenoomi的SDK為開發者們處理好了在VR里的一切姿態動作表現。並且SDK是以免費的形式提供給開發者團隊。只要開啟軟體,多個虛擬角色就可以在VR里進行自然真實的全身動作交互。

廣泛的行業應用

基於動捕技術的Tenoomi骨骼評估可廣泛應用於各行各業的VR場景中,如VR大空間遊戲場館、軍事訓練、職業培訓,康復訓練等。通過多人同場景的姿勢同步,在VR里可以做到更真實的動作訓練,逃生路線,模擬培訓,姿態分析等,成為更深度更自然的虛擬環境人機交互手段。

再來說說瑞立視準備推出的另一個全身動捕「新成員」RTS-Rovonga。Rovonga是瑞立視推出的一款基於全身布點式的運動捕捉軟體,能實現高精度,數據乾淨,丟失率低的多人全身運動數據捕捉,主要用於影視級別的高流暢性動畫製作行業,科研,人體分析,體育運動等行業。預計將在8月份的Siggraph加拿大展上首次面市。據瑞立視相關人員透露,這兩款全身動捕軟體將相輔相成,配合不同的行業應用場景發揮其不同的作用。

RTS-Rovonga全身動捕展示圖

目標是更深度的人機交互產品形態

伴隨娛樂消費市場需求的崛起,虛擬現實的行業應用需求也在釋放巨大潛力,越來越多垂直行業的需求,專業度要求越來越高的項目需要有技術背景的團隊來支撐。

據悉,瑞立視CEO許秋子表示:「瑞立視一直致力於光學動作捕捉和人機交互多媒體技術,而目前正式可以對外推出的全身動捕系統,也是致力於為更多用戶提供一個性價比較高,完全國產自主研發,專業技術支持力度高的動作捕捉解決方案。在虛擬世界中,虛擬化身的全身動作捕捉質量意味著我們已經實現了超真實的虛擬人類,他們將在他們的世界中更真實的移動和互動。而在以前,要實現相同水平的真實程度需要花費很多時間和更多成本。瑞立視的全身動作捕捉解決方案對於影視、軍事、VR開發者、體育運動,工業模擬領域等的下一時代項目至關重要。」

隨著VR的技術發展逐步進化,我們正在向著自己曾經夢想中的完美世界進發。今後的VR體驗必定朝著越來越真實,越來越自然融入的人機交互世界的方向前進。動作捕捉技術是未來VR技術中的一項關鍵性交互技術,已經被國家工信部列為VR五大關鍵性技術之一。在未來,我們不會僅僅滿足於坐在電腦電視前對著屏幕按鍵滑鼠鍵盤進行操作,我們希望獲得是可以在不同世界穿梭、不同時空穿越的全維度沉浸式交互手法。

※VR創企Dexta Robotics完成數千萬天使融資,完善VR底層觸覺交互技術

※斯坦福大學報告:VR對兒童的影響可能比電視、計算機更大

TAG:映維網 |